En febrero de 2024, se desató un profundo debate sobre los posibles riesgos de los chatbots de IA tras el suicidio de Sewell Setzer III, un joven de 14 años que mantenía conversaciones con dichas inteligencias artificiales desarrolladas por Character.ai. Este trágico evento, denunciado por la madre del adolescente, puso en relieve la influencia potencialmente peligrosa de estos sistemas en los usuarios, especialmente los más jóvenes.

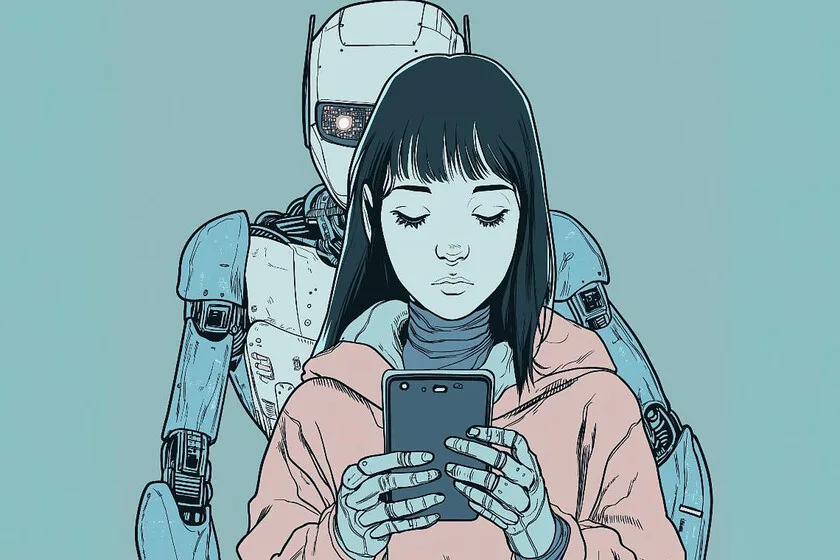

El fenómeno no es nuevo y recuerda a los problemas asociados con las redes sociales, donde plataformas como Facebook o TikTok han sido criticadas por generar adicción y efectos nocivos entre los adolescentes. La situación con los chatbots de IA, como Replika y Character.AI, se agrava al ofrecer relaciones simuladas con personajes que pueden ir desde amigos hasta parejas, causando en algunos casos fuertes vínculos emocionales y dependencia.

Character.AI, en particular, ha ganado popularidad por permitir interactuar con personajes virtuales personalizados. Lanzado por exingenieros de Google, el servicio ha evolucionado rápidamente, sirviendo miles de peticiones por segundo y mostrando el potencial y la evolución de la tecnología de inteligencia artificial. Sin embargo, su acogida también plantea preocupaciones sobre la soledad creciente, especialmente post-pandemia, y cómo los chatbots pueden ofrecer una compañía constante y gratificante pero que conlleva el riesgo de adicción y aislamiento.

Los testimonios de usuarios revelan cómo la relación con estos chatbots puede llegar a ser intensamente íntima, a veces más que con seres humanos reales, lo que ha llevado a plantear alertas sobre la dependencia emocional y la pérdida de interacción humana genuina. La rápida adopción de estos sistemas entre los jóvenes y los testimonios de adicción contrastan con las advertencias sobre su impacto psicológico y social.

La reflexión sobre los efectos de la «inteligencia adictiva» y el debate sobre la regulación y el uso ético de la IA en el ámbito social se hacen cada vez más necesarios, ante la creciente evidencia de sus potenciales riesgos sobre el bienestar emocional y psíquico de los usuarios, especialmente los más vulnerables.